Les STT modernes restent opaques pour beaucoup de devs. On sait qu’il y a des “transformers” et du “spectrogramme mel”, mais concrètement ? Flou artistique.

J’ai voulu comprendre ce qui se passe vraiment entre le moment où quelqu’un parle et le moment où le texte apparaît. Pas les formules mathématiques - juste le mécanisme, étape par étape.

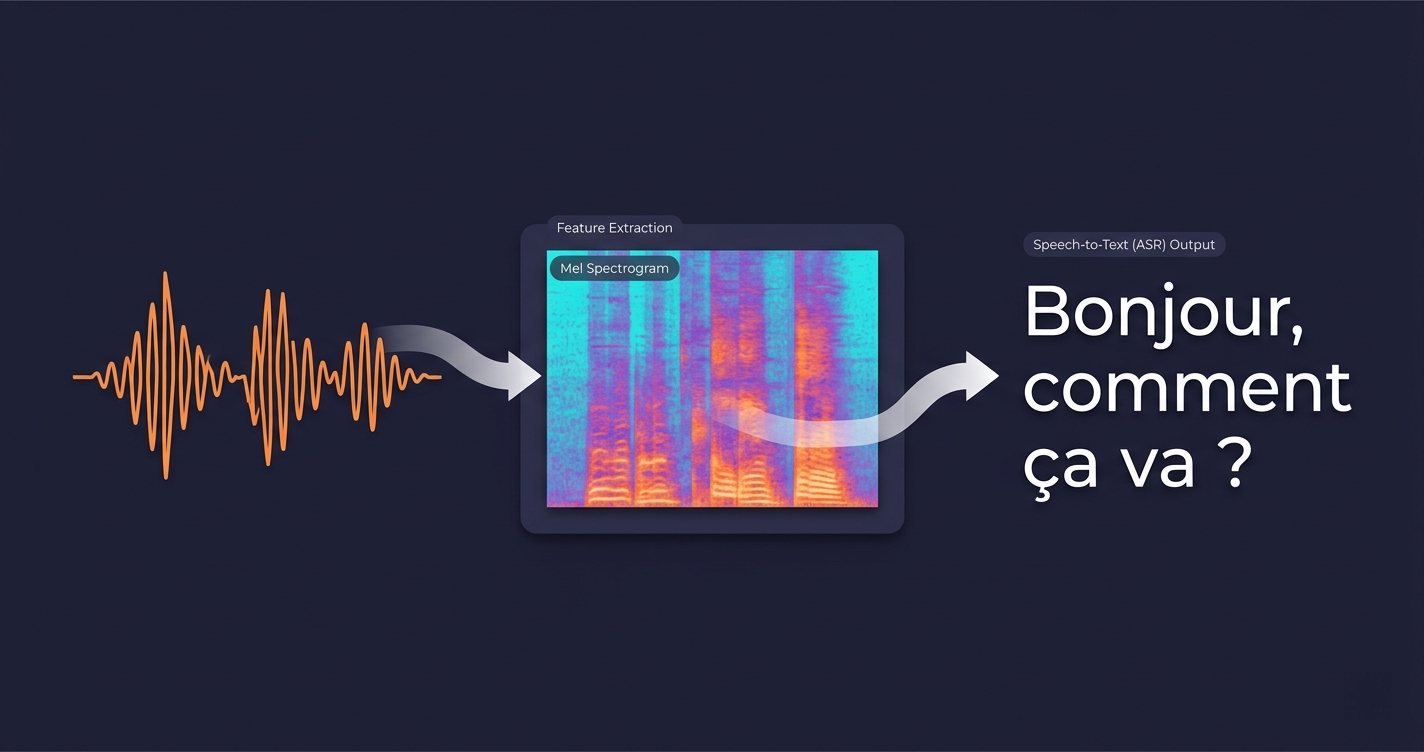

J’ai créé ce guide visuel avec un fil rouge simple : la phrase “Bonjour, comment ça va ?” traverse chaque couche du pipeline. De l’onde sonore brute jusqu’à la transcription finale avec timestamps.

Ce que le guide couvre

Le parcours complet d’un signal audio à travers Whisper :

- Audio Input : onde sonore, échantillonnage, sample rate 16 kHz

- Mel Spectrogram : FFT, filtres mel, perception humaine des fréquences

- Feature Extraction : log-mel, normalisation, format d’entrée du modèle

- Encoder : convolutions, Transformer 32 couches, self-attention

- Decoder : génération auto-régressive, cross-attention, KV cache

- Timestamps : segment-level et word-level, alignement DTW

Chaque étape est illustrée avec des schémas et des exemples concrets.

Les optimisations expliquées

Le guide couvre aussi les techniques pour passer en production :

- CTranslate2 : le backend C++ de faster-whisper, ~4x plus rapide

- Quantization : int8 pour +30-50% de vitesse avec ~0.5% de WER en plus

- Batching : saturer le GPU avec plusieurs audios en parallèle

- VAD : Voice Activity Detection pour skipper les silences et éviter les hallucinations

Comparatif des modèles

Le guide inclut un comparatif détaillé entre Whisper large-v3, le turbo, Canary (NVIDIA), Parakeet et distil-whisper. Avec les métriques WER et RTFx pour chaque configuration.

Pourquoi ce format

J’apprends mieux avec des visuels qu’avec des équations. Ce guide est celui que j’aurais voulu trouver quand j’ai commencé à bosser sur la transcription automatique.

Pas de prérequis en machine learning. Si vous savez ce qu’est un vecteur et une matrice, vous pouvez suivre.